Création de l'image LRVB (1/3)

Ecrit le 28/09/2022.

Nous voici maintenant en possession de 4 images de notre objet, créées précédemment : 3 images créées chacune à partir des filtres couleurs rouge, vert et bleu et une image créée à partir du filtre luminance. Ces images sont dites linéaires, car le signal qu’elles affichent est directement proportionnel à la quantité de lumière reçue lors des acquisitions. Elles seront plus tard transformées en images non linéaires (par exemple en faisant un « classique » étirement d’histogramme). Avant cela, nous allons commencer par créer et traiter une image couleur de l’objet (RVB), puis traiter sa Luminance et enfin mixer les deux en une image appelée LRVB.

Nous allons suivre les étapes suivantes :

1-Création de l’image RVB.

2-Suppression des bordures noires.

3-Retrait des gradients sur la RVB.

4-Calibration des couleurs.

5-Crop de la Luminance.

6-Retrait des gradients sur la Luminance.

7-Déconvolution.

8-Réduction du bruit.

9-Passage en mode non-linéaire.

10-Création de l’image LRVB.

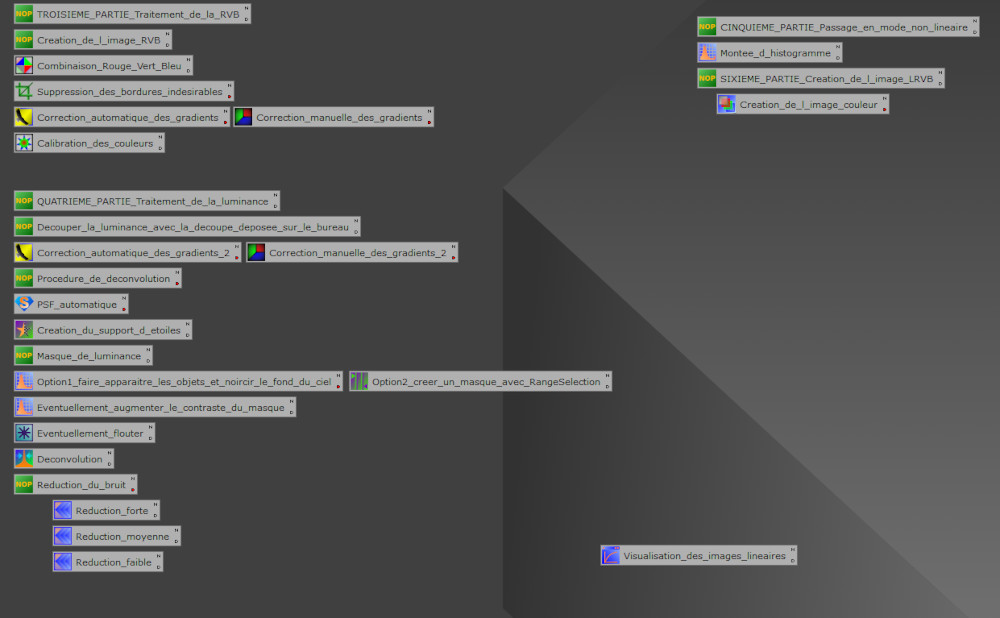

Pour suivre les opérations effectuées dans cet article, je vous invite à télécharger les process icons correspondants en cliquant ici ... Vous obtenez ainsi la liste des process suivante :

1-Création de l'image RVB

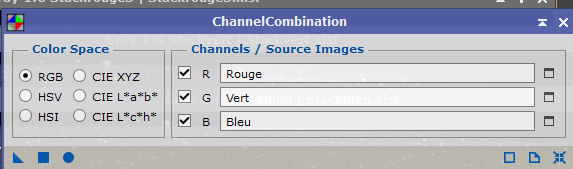

Nous commençons par ouvrir nos 3 images couleur (si ça n’est pas le cas) puis nous cliquons sur Combinaison_Rouge_Vert_Bleu afin d’ouvrir le process ChannelCombination :

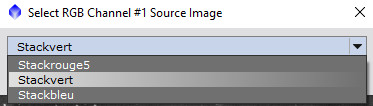

On entre tout simplement le nom de chacune des images couleur dans les cases correspondantes, en cliquant sur l’icône à droite de chacune des couches ![]() puis en sélectionnant la bonne image dans la liste déroulante :

puis en sélectionnant la bonne image dans la liste déroulante :

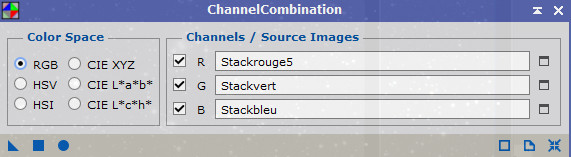

Le process est maintenant correctement rempli :

On clique sur le disque bleu et l’image couleur est créée. Il faut cependant activer la STF afin de pouvoir en visualiser l’apparence (en décochant éventuellement l’icône Link RGB Channels du process STF) :

Voici donc enfin une image couleur de notre nébuleuse, que nous allons travailler un peu. Il peut-être utile de la sauvegarder, en l’appelant par exemple RVB.

2-Suppression des bordures noires

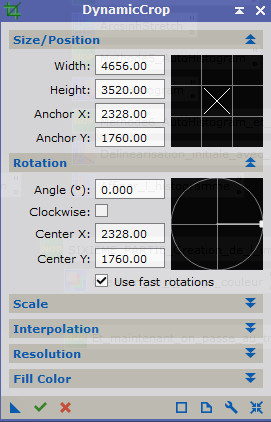

Comme nous pouvons le voir (et c’est encore plus flagrant dans notre exemple étant donné qu’il y a eu une rotation de la caméra d’acquisition entre les photos des couches couleurs et les photos de luminance), notre objet est entouré de bandes noires qu’il nous faut supprimer. On clique donc sur Suppression_des_bordures_indésirables afin de lancer le process DynamicCrop :

Un cadre apparaît autour de notre image, qui va nous servir à « croper » (c’est-à-dire « découper ») la partie centrale de notre image, afin d’en supprimer les bords indésirables :

A l’aide de la souris, nous pouvons déplacer chacun des bords du cadre individuellement pour entourer la partie de l’image qui nous intéresse, ou encore en plaçant la souris à l’intérieur il est possible de déplacer le cadre en entier.

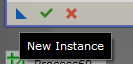

Une fois ces réglages effectués, il va falloir faire quelque chose de TRES IMPORTANT pour la suite.

Nous allons avec la souris sur le petit triangle rectangle bleu « New Instance » en bas à gauche de la fenêtre du process :

On laisse le bouton gauche de la souris enfoncé et on la déplace sur une zone vide de l’écran de Pixinsight avec d’y déposer une sauvegarde du process DynamicCrop avec les réglages que l’on vient d’effectuer.

Ainsi, nous pourrons réutiliser dans la suite les mêmes paramètres de « crop » sur l’image Luminance, pour obtenir une image de même dimension que l’image RVB. Si l’on oublie de faire cela, nos images RVB et Luminance n’auront pas les mêmes dimensions et il nous sera alors impossible de les fusionner ! Il ne faut donc surtout pas oublier cette étape !

Ceci étant fait, on clique sur la coche verte en bas de la fenêtre du process DynamicCrop afin de procéder au découpage de notre image, qui se retrouve ainsi débarrassée de ses bordures noires.

3-Retrait des gradients sur la RVB

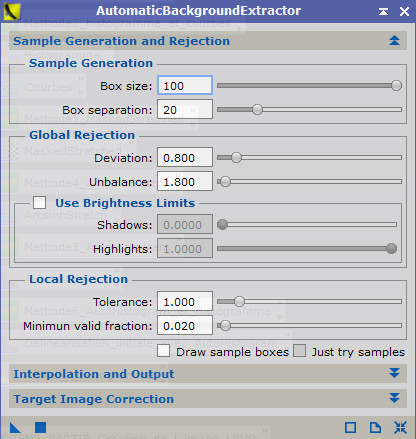

Comme on peut le constater, le fond de ciel sur mon image est loin d’être uniforme, en particulier parce mes acquisitions ont été effectuées sous un ciel pollué par l’éclairage urbain tout proche. On voit par exemple dans le coin en haut à gauche de l’image une zone rouge qui est la conséquence de cette pollution lumineuse. Nous allons tenter d’arranger cela en utilisant l’un des process de correction du fond du ciel de Pixinsight. Pour cela on clique sur Correction_automatique_des_gradients afin de lancer le process AutomaticBackgroundExtractor :

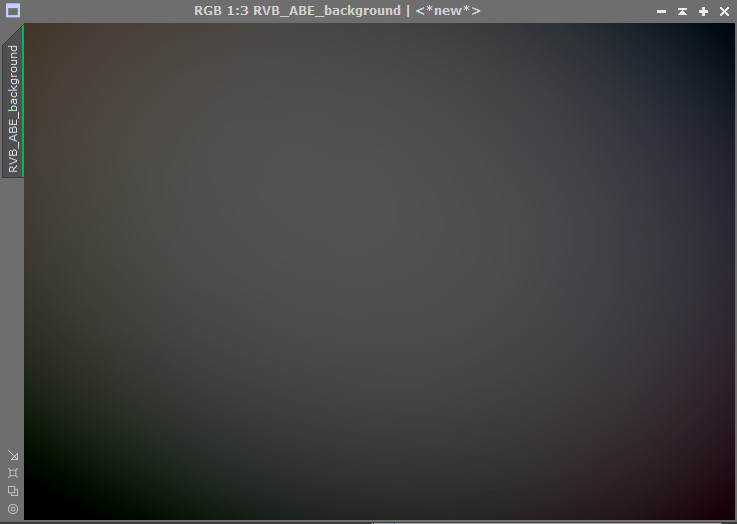

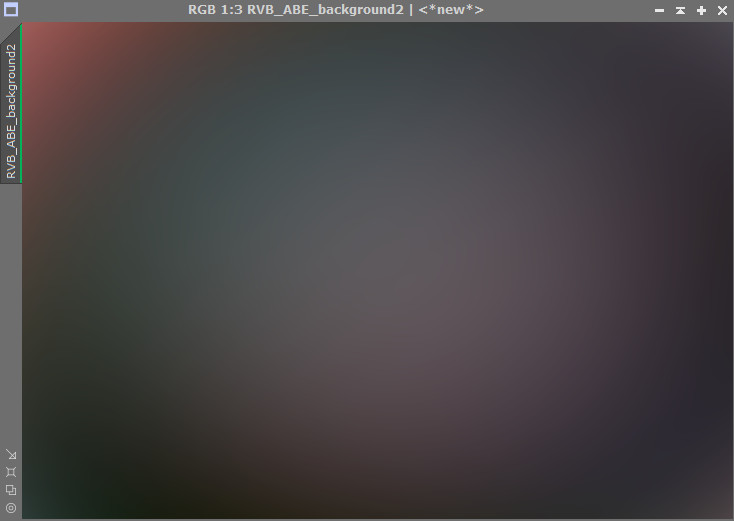

On peut déjà voir ce qui se passe en l’appliquant directement sur l’image : le process crée une image avec un nom du type RVB_ABE_background et une image corrigée avec un nom du type RVB_ABE. En visualisant l’image « background » avec la STF, on peut observer la façon dont le process a modélisé le fond de ciel :

On peut constater que le process n’a pas forcément bien pris en compte en particulier le coin en haut à gauche que j’aurais souhaité corriger.

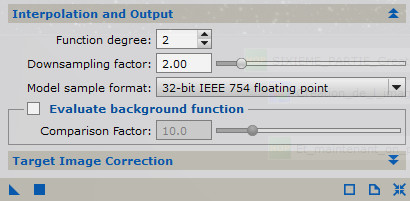

Du coup je vais aller modifier un paramètre de mon process : on ouvre la zone Interpolation and Output et on va changer le paramètre Function degree que j’ai réglé par défaut sur 2 dans mes process icons.

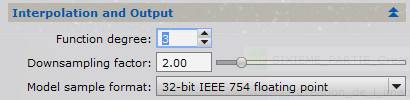

Cette valeur modifie le degré de la fonction qui est utilisée par le process pour modéliser le fond du ciel. Dans des cas de gradients « simples », ce paramètre fonctionne souvent bien me semble t’il. Si ça n’est pas le cas comme ici, on va augmenter la valeur de Function degree pour améliorer la précision de la modélisation, en le montant à 3 pour commencer :

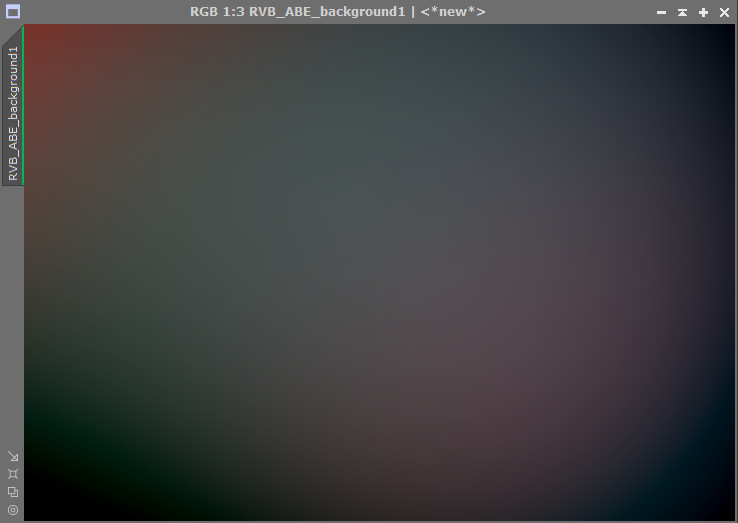

On réapplique à nouveau le process sur l’image initiale, et en examinant l’image de background obtenue, on peut constater cette fois que le coin supérieur gauche est bien contenu dans le modèle :

Ceci se voit maintenant sur l’image produite par le process, dont le fond est bien mieux corrigé :

En augmentant la valeur de Function degree à 4, on obtient un modèle de fond de ciel encore un peu plus « accentué » :

Le résultat final peut être considéré comme satisfaisant :

A partir de là, il est possible d’essayer de réappliquer plusieurs fois le process sur l’image, ce qui peut améliorer parfois encore un peu le résultat. Sur cette image le résultat me semble correct, mais il est parfois difficile de corriger des gradients compliqués (qu’on obtient parfois quand on cumule des images effectuées sur différentes nuits, avec des niveaux de ciel différents ou quand l’objet a été photographié dans des positions du ciel éloignées les unes des autres et n’est donc pas affecté de la même façon sur chaque photo par la pollution lumineuse).

Quand AutomaticBackgroundExtractor n’est pas suffisant, il est préférable d’utiliser le process DynamicBackgroundExtractor (que j’ai nommé Correction_manuelle_des_gradients dans mes process icons) mais dont le fonctionnement diffère complètement, ceci mériterait sans doute un autre tutoriel pour être expliqué…

4-Calibration des couleurs

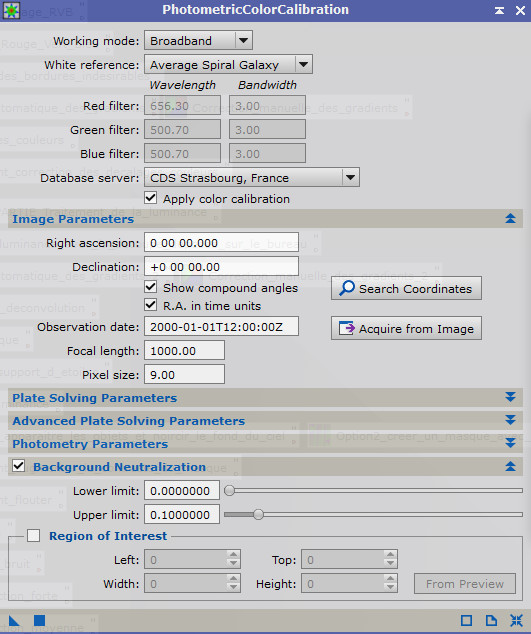

Pour terminer le traitement de notre image, il est nécessaire maintenant de faire la calibration des couleurs. On clique sur Calibration_des_couleurs afin d’ouvrir le process PhotometricColorCalibration :

Pour fonctionner, le process va se connecter à Internet et aller chercher les coordonnées de l’objet photographié, afin de pouvoir calibrer les couleurs de l’image par rapport à des catalogues de référence.

On clique d’abord sur le bouton Search Coordinates ![]() .

.

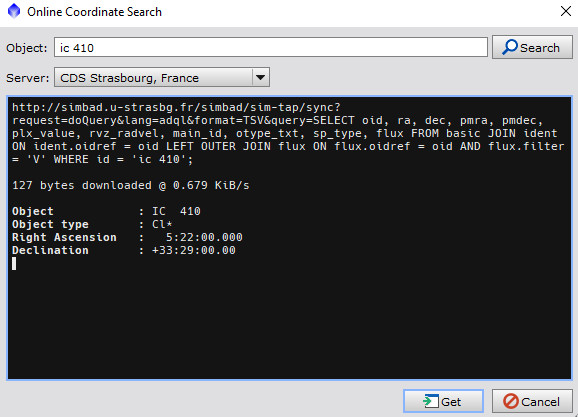

Dans la fenêtre qui s’ouvre, on entre dans la zone Object le nom de notre cible (ici IC 410) et on clique sur Search. Si tout va bien, notre objet est trouvé et il n’y a plus qu’à cliquer sur Get pour obtenir ses coordonnées.

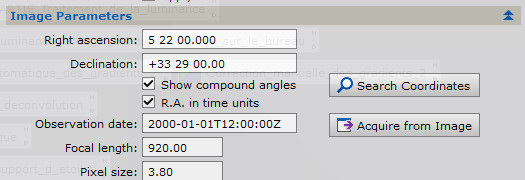

A partir de là, les coordonnées en Ascension Droite (Right ascension) et en Déclinaison (Declination…) apparaissent dans notre process. On entre dans la case Focal lenght la longueur focale de l’instrument de prise de vue en mm (dans mon cas, 920) et dans la case Pixel size la taille des pixels de la caméra d’acquisitions en microns (ici 3,80 pour la caméra ZWO 1600 Pro).

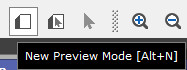

On peut créer un preview en cliquant sur New Preview Mode  .

.

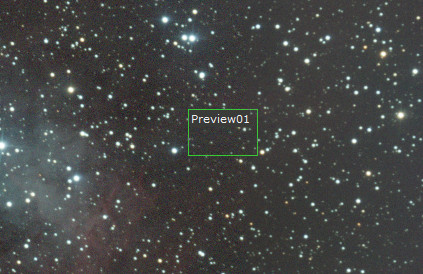

On sélectionne avec la souris une zone de ciel (sans trop d’étoiles) afin de réaliser une neutralisation du fond de ciel.

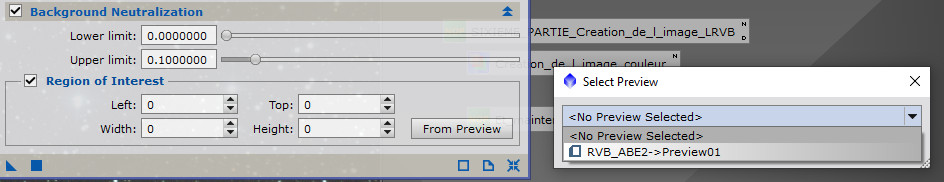

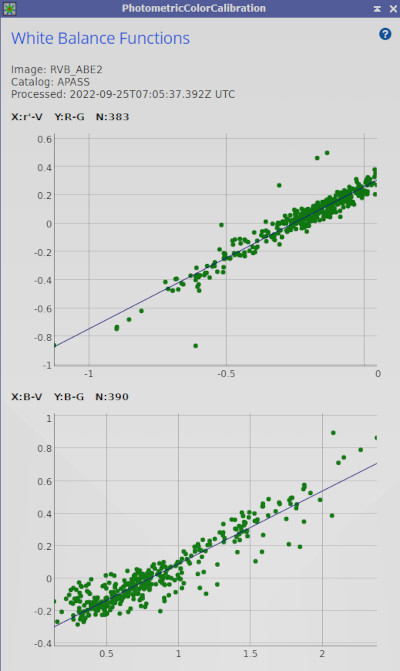

Sur la fenêtre du process, on va tout en bas dans la zone Backgound Neutralization, et on coche la case Region of Interest. On clique le bouton From Preview et, dans le menu déroulant, on choisit le nom du preview que l’on vient de créer :

Le process est prêt, il ne reste plus qu’à l’appliquer sur l’image. Cela prend un certain temps, si tout se passe bien le process réalise une astrométrie sur l’image en détectant les coordonnées des étoiles présentes puis réalise différentes opérations. A la fin des graphiques s’affichent, qui indiquent, si j’ai bien compris, la qualité de la calibration. Le but est qu’il y ait un maximum de points verts groupées autour de chacune des droites…, mais je ne saurais en dire plus ![]() !

!

Voilà, nous en avons terminé avec le traitement de notre image RVB, on peut la sauvegarder ou la garder précieusement dans un coin et nous allons maintenant nous occuper de l’image de Luminance.